أعلنت شركة ميتا عن إطلاق نماذج Llama 3.2، وهي عائلة من نماذج اللغات الرائدة التي تتميز بقدرات محسّنة وقابلية تطبيق أوسع ودعم متعدد الوسائط للصور، وهي متاحة الآن في Amazon Bedrock. يمثل هذا الإصدار تقدمًا كبيرًا في مجال نماذج اللغات الكبيرة (LLMs) ويوفر إمكانات محسّنة وقابلية تطبيق أوسع عبر حالات استخدام متنوعة.

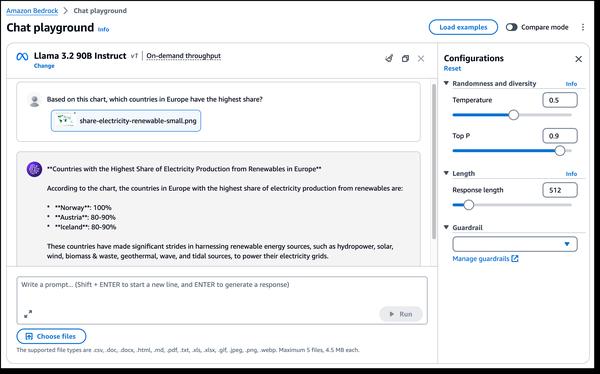

أحد الجوانب المثيرة للاهتمام في Llama 3.2 هو إدخال قدرات الرؤية متعددة الوسائط. تم تصميم النماذج الجديدة 90B و 11B لفهم الصور والتفكير البصري، مما يفتح إمكانيات جديدة لتطبيقات مثل التعليق على الصور واسترجاع الصور النصية والإجابة على الأسئلة المرئية. يمكن أن تحدث هذه القدرات ثورة في الطريقة التي نتفاعل بها مع الصور ونستخدمها في مختلف المجالات.

بالإضافة إلى ذلك، تقدم Llama 3.2 نماذج خفيفة الوزن مناسبة لأجهزة الحافة. تم تصميم النماذج 1B و 3B لتكون فعالة من حيث الموارد مع تقليل زمن الوصول وتحسين الأداء، مما يجعلها مثالية للتطبيقات على الأجهزة ذات القدرات المحدودة. يمكن أن يؤدي هذا إلى تطوير مساعدين للكتابة يعملون بالذكاء الاصطناعي وتطبيقات خدمة عملاء أكثر ذكاءً على الأجهزة المحمولة.

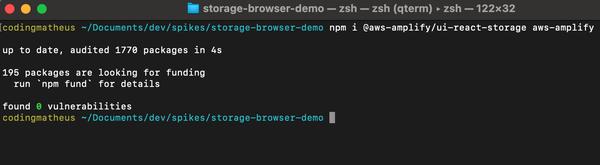

علاوة على ذلك، تم بناء Llama 3.2 على Llama Stack، وهي واجهة موحدة لبناء مكونات سلسلة أدوات أساسية وتطبيقات عاملة، مما يجعل البناء والنشر أسهل من أي وقت مضى. يوفر هذا للمطورين طريقة قياسية وفعالة لدمج نماذج Llama في تطبيقاتهم.

بشكل عام، يمثل إصدار Llama 3.2 خطوة كبيرة إلى الأمام في مجال نماذج اللغات الكبيرة. تفتح قدراتها المحسّنة وقابلية تطبيقها الأوسع إمكانيات جديدة لمجموعة واسعة من حالات الاستخدام، من فهم الصور والتفكير البصري إلى التطبيقات على أجهزة الحافة. مع استمرار تطور تقنية الذكاء الاصطناعي التوليدية، يمكننا أن نتوقع المزيد من الابتكارات والتطبيقات التحويلية من نماذج مثل Llama 3.2.