أعلنت جوجل كلاود عن تحديثات هامة لبرمجيات AI Hypercomputer، تركز على تحسين أداء التدريب والاستدلال، وتعزيز المرونة على نطاق واسع، وتوفير مركز مركزي لموارد AI Hypercomputer.

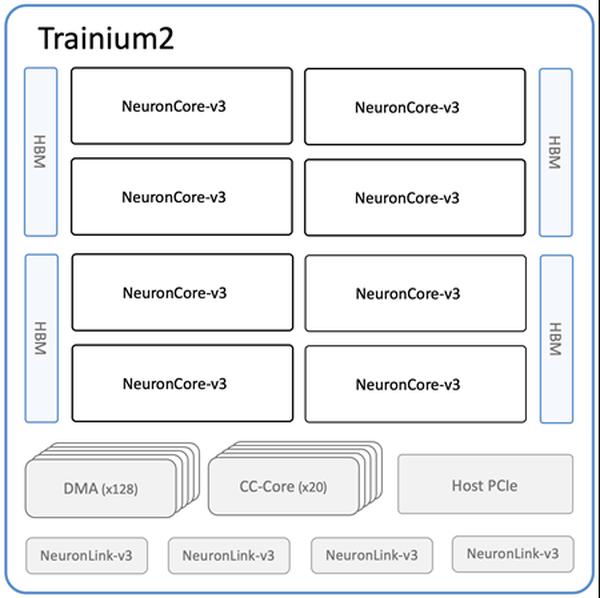

من أبرز التحديثات دعم MaxText لـ A3 Mega VMs، مما يتيح تدريب نماذج اللغة الكبيرة (LLMs) بشكل أسرع وأكثر كفاءة. توفر هذه الأجهزة الافتراضية، التي تعمل بوحدات معالجة الرسومات NVIDIA H100 Tensor Core، تحسينًا بنسبة 2X في عرض النطاق الترددي للشبكة من وحدة معالجة الرسومات إلى وحدة معالجة الرسومات مقارنةً بأجهزة A3 VMs.

علاوة على ذلك، قدمت جوجل كلاود SparseCore على Cloud TPU v5p، مما يوفر تسريعًا للأجهزة لعمليات تضمين الكلمات، مما يؤدي إلى تحسين أداء أنظمة التوصية.

لتحسين استدلال LLM، قدمت جوجل كلاود أيضًا تكميم ذاكرة التخزين المؤقت KV ونوى الانتباه غير المنتظمة في JetStream، مما أدى إلى تحسين أداء الاستدلال بما يصل إلى 2X على Cloud TPU v5e.

من خلال هذه التحديثات، تواصل جوجل كلاود تمكين المؤسسات من تسريع رحلات الذكاء الاصطناعي الخاصة بها من خلال توفير بنية تحتية عالية الأداء وفعالة من حيث التكلفة. إن التركيز على الأجهزة والبرامج المحسنة، إلى جانب الموارد الشاملة، يجعل AI Hypercomputer حلاً جذابًا للمؤسسات التي تتطلع إلى الاستفادة من قوة الذكاء الاصطناعي.